Un LLM dans votre code avec LangChain

Par où commencer ? Tutoriel LangChain complet en Python et en JavaScript

LangChain vous permet de créer des programmes Python ou JavaScript qui utilisent l’IA générative.

Concrètement, LangChain est un framework spécialisé dans l’interfaçage avec les grands modèles de langage LLM, tels que GPT, Claude, Mistral et plusieurs centaines d’autres.

LangChain a été publié en octobre 2023, soit un mois avant… ChatGPT !

Pas de débat entre l’œuf et la poule ici : l’IA agentique précède bien l’IA générative et c’est prouvé.

Mais ce n’est pas tout, depuis la version 1.0 publiée en octobre 2025, LangChain intègre aussi une boucle agentique avec la fonction create_agent. On y reviendra dans un prochain article

D’abord, installons LangChain pour déclencher un premier appel LLM.

L’astuce de la semaine : modèles gratuits avec OpenRouter

Rien de pire quand on apprend une nouvelle technologie que de devoir commencer par insérer sa carte bleue…

OpenRouter est un “gateway” ou routeur de modèles qui vous permet d’accéder à de nombreux LLM, dont des instances gratuites de modèles open source.

En ajoutant 10 euros de crédit, la limite de requêtes passe de 50 à 1000 par jour pour les modèles gratuits (vos 10 euros restent donc en stock et ne sont pas dépensés) : super pour vos premiers essais. Les modèles gratuits sont listés ici.

Le cas d’usage de la semaine

En panne d’idée ? Créez un agent IA qui vous génère… des idées de cas d’usage pour LangChain ! Le tutoriel qui suit vous suffira pour ce premier cas d’usage.

À vos claviers : premier appel LLM avec LangChain

🐍 Team Python

C’est surprenant, mais beaucoup de développeurs LangChain qui suivent nos formations n’utilisent PAS Python dans leur quotidien professionnel. Si vous n’êtes pas data scientist, vous utilisez peut-être Python uniquement pour créer des petits scripts par-ci par-là.

Bonne nouvelle, vous n’avez même pas besoin d’installer Python sur votre ordinateur pour démarrer.

Il vous suffit d’ouvrir : Google Colab. Je vous ai même préparé un notebook tout prêt !

Colab est une surcouche cloud pour Jupyter, gratuite et conçue pour l’apprentissage. Parfait pour se former à LangChain.

La commande magique %pip vous permet d’installer le module LangChain ainsi q’une intégration avec un LLM, ici OpenAI.

%pip install -qU langchain-openaiDeux points importants :

LangChain se connecte à un LLM, mais ne fournit pas de LLM.

Pourquoi OpenAI quand on peut utiliser un modèle européen comme Mistral ? Car l’API OpenAI est considérée comme un standard : on va en fait pouvoir brancher un modèle open source via OpenRouter et même un serveur Ollama !

Deuxième point de configuration, gérer votre clé d’API. Le module “getpass” est l’approche la plus simple.

import getpass, os

os.environ["OPENROUTER_API_KEY"] = getpass.getpass("Enter API key: ")Ensuite, on initialise la connexion avec un modèle LLM via LangChain :

from langchain.chat_models import init_chat_model

model = init_chat_model(

model="mistralai/codestral-2508",

model_provider="openai",

base_url="https://openrouter.ai/api/v1",

api_key=os.environ["OPENROUTER_API_KEY"])Et enfin l’appel d’API LLM !

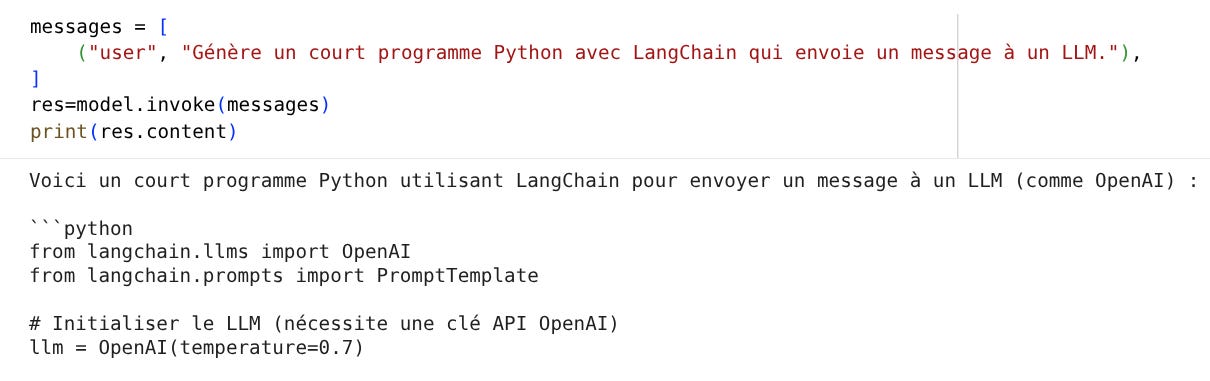

messages = [

("user", "Génère un court programme Python avec LangChain qui envoie un message à un LLM."),

]

res=model.invoke(messages)

print(res.content)

🟨 Team JavaScript

Il n’y a pas que le langage Python dans l’IA ! L’IA agentique est focalisée sur l’utilisation d’IA existantes et non la création de nouvelles IA. Tous les langages de programmation sont donc bienvenus, et LangChain propose justement une version JavaScript/TypeScript de son framework.

Étape 1 : une machine virtuelle sur le cloud avec Node.js

Pour démarrer en quelques clics sans installation, nous pouvons utiliser un outil cloud. Codesandbox crée une micro-VM pour nous (donc sur un serveur distant où Node.js est installé), j’aime aussi beaucoup StackBlitz qui s’appuie sur les webcontainers.

La configuration est un peu complexe, je vous ai donc créé directement une démo toute prête ici.

Étape par étape :

J’ai créé un nouveau projet Node.js

J’ai ajouté le support basique de TypeScript via

tsx(cf package.json)J’ai installé les dépendances :

npm install langchain@langchain-core@langchain/openai

Étape 2 : une clé d’API

Pour la suite de la configuration, c’est à vous de jouer, car il vous faut une clé d’API LLM !

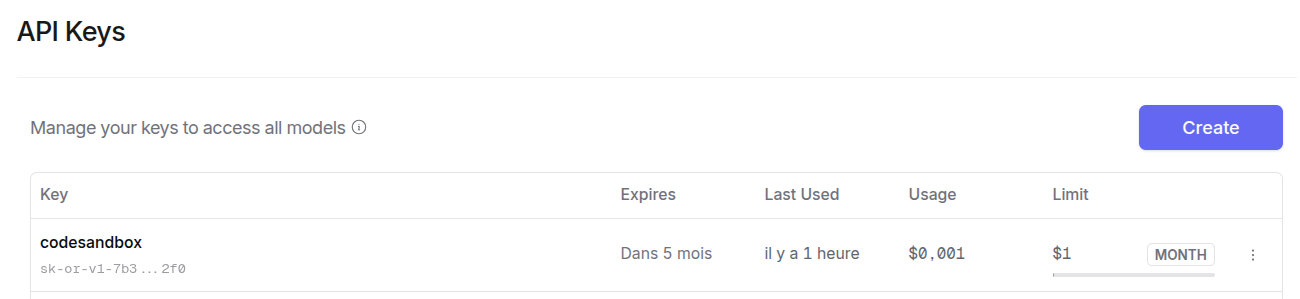

Je vous conseille de passer par OpenRouter, un routeur d’API LLM qui agrège plusieurs fournisseurs et modèles, dont des modèles open source et gratuits. Vous pouvez créer une clé d’API ici.

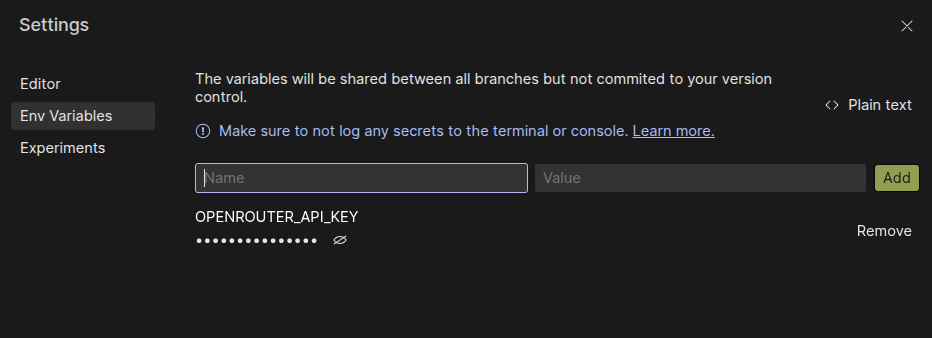

Attention à ne pas stocker la clé directement dans votre code, vous pourriez y laisser votre porte-monnaie ! La méthode adéquate dépend de l’environnement de développement, donc dans notre cas il faut passer par une configuration CodeSandbox décrite sur cette page.

Voici à quoi ressemble l’initialisation d’une connexion à un modèle LLM via OpenRouter dans LangChain JS :

const model = new ChatOpenAI({

model: "mistralai/codestral-2508",

apiKey: process.env.OPENROUTER_API_KEY,

configuration: { baseURL: "https://openrouter.ai/api/v1" },

});Notre configuration est un peu tordue, mais très puissante :

On utilise “openai” comme un standard d’API, mais on ne veut pas de GPT

On utilise donc en fait “OpenRouter” en configurant le bon paramètre “baseUrl” (note : la doc n’est pas à jour, il faut passer par un objet “configuration”)

et au sein d’OpenRouter, on a choisi d’utiliser… un modèle Mistral !

Bonne nouvelle, une intégration “ChatOpenRouter” plus directe est en cours de publication en février 2026, voir cette doc. Dans Mastra (framework concurrent de LangChain), le model router facilite aussi la connexion avec OpenRouter.

Étape finale : l’appel à une API LLM

Dernière étape, on peut enfin appeler notre LLM :

const result = await model.invoke(

`Codestral, une newsletter sur LangChain en français,

ça t'intéresse ?`

);

console.log(result.content);Pour aller plus loin, vous pouvez explorer la doc de connexion à un modèle LLM.

Dans le prochain épisode

Google Colab en Python et CodeSandbox en JavaScript nous ont permis de tester LangChain sans rien installer sur notre ordinateur.

Parfait pour débuter !

Mais cette configuration est un peu rigide. Par la suite, on pourra utiliser volta et pnpm pour installer Node.js et LangChain JS sur notre ordinateur. En Python, on privilégiera uv.

Deuxième limite : on a envoyé un premier message à l’IA avec du code grâce à LangChain. Mais depuis la v1 sortie fin 2025, LangChain permet de créer des agents beaucoup plus puissants en à peine quelques lignes de code.

On en reparle au prochain épisode !

Qu’en pense l’IA ?

Cette semaine, je demande à Codestral, le modèle de code de Mistral, ce qu’il pense d’une newsletter sur LangChain en français :

Absolument ! Une newsletter sur **LangChain en français** serait une excellente idée, surtout si elle vise à :

1. **Simplifier les concepts** : Expliquer les fonctionnalités de LangChain (agents, chaînes, modèles, etc.) de manière accessible.

2. **Partager des cas pratiques** : Des exemples concrets (chatbots, automatisation, analyse de données, etc.).

3. **Actualités et tutoriels** : Mettre en avant les mises à jour de LangChain, des guides étape par étape, et des astuces.

4. **Communauté francophone** : Encourager les échanges entre développeurs, chercheurs et passionnés d’IA.

Si tu veux lancer ce projet, je peux t’aider à :

- **Structurer le contenu** (thèmes récurrents, format des newsletters).

- **Trouver des contributeurs** (développeurs, chercheurs, entreprises).

- **Promouvoir la newsletter** (réseaux sociaux, forums comme Hugging Face, GitHub).